1. 제목

DreamActor-M1: 하이브리드 가이드와 점진적 학습으로 구현한 고정밀 인간 이미지 애니메이션

– 스케일 적응성과 시간 일관성을 동시에 달성한 새로운 애니메이션 프레임워크

2. 개요 (Intro)

영상 기반 인간 이미지 애니메이션은 디지털 휴먼, 가상현실, 콘텐츠 제작 등에서 핵심 기술로 주목받고 있습니다.

최근에는 정적 이미지 한 장에서 자연스러운 표정, 포즈, 동작 시퀀스를 생성하고자 하는 수요가 늘고 있지만, 기존 방법은 다음과 같은 한계를 안고 있습니다:

- 얼굴 및 자세 표현의 정밀 제어가 어려움

- 다양한 스케일 (초상화~전신)에 대한 적응 부족

- 긴 시퀀스에서 외형이 일관되지 않는 문제

DreamActor-M1은 이 세 가지 문제를 동시에 해결하기 위해 고안된 신경망 기반 애니메이션 생성 프레임워크로, 세밀한 모션 제어, 다양한 스케일 대응, 장기간 외형 일관성을 달성한 것이 특징입니다.

3. 문제 정의

DreamActor-M1은 다음 세 가지 핵심 문제에 집중합니다:

- 세밀한 표현력 부족: 기존 모션 추론 시스템은 정밀한 표정이나 자세를 구현하지 못함.

- 스케일 다양성 대응 한계: 초상화, 상반신, 전신 이미지에 동일한 품질의 애니메이션 적용 어려움.

- 시간 일관성 결여: 긴 시퀀스에서 인물 외형이 변화하거나 깨지는 문제 발생.

4. 핵심 내용 정리

4.1 하이브리드 모션 가이드 시스템

DreamActor-M1은 세 가지 수준의 모션 가이드를 병합하여 동작 제어를 정밀하게 수행합니다:

- 암시적 얼굴 표현: Latent space 상의 감정 표현 학습 → keypoint 기반보다 더 자연스러운 얼굴 애니메이션

- 3D Head Sphere: 반구형 머리 포즈 컨트롤 → yaw, pitch, roll 각도 제어 및 얼굴 비율 유지

- 3D Body Skeleton: SMPL 기반 신체 구조 → 신체 동작과 자세의 정밀 제어 가능

4.2 외형 일관성 유지 구조

긴 애니메이션에서도 외형이 흐트러지지 않도록 두 가지 핵심 기법 적용:

- 다중 프레임 참조(Multi-Frame Reference Fusion): 이전 프레임과 참조 이미지를 동적 융합해 외형 정보 보존

- 시각적 기억 통합(Visual Memory Aggregator): 시간 attention 구조 활용 → 외형 정보를 장기 메모리에 보존

4.3 점진적 스케일 학습 전략

다양한 스케일(해상도)에 대응하는 학습 전략 도입:

- 커리큘럼 기반 학습: 초상화 → 상반신 → 전신 순으로 단계적 학습 진행

- 다중 해상도 판별기: 다양한 스케일에서 성능을 보장하기 위한 parallel discriminator 구조

- Latent Feature Fusion: 고·저해상도 피처 융합을 통한 강건한 표현력 확보

5. 주요 결과 요약

5.1 정량적 성능 비교

| 방법 (Method) | FID ↓(사실성) | LPIPS ↓(시각적 유사도) | 시간 일관성 ↑(Temporal Consistency) |

|---|---|---|---|

| DreamTalk | 31.2 | 0.173 | 56.4% |

| Thin-Plate Warping | 29.8 | 0.165 | 59.1% |

| DreamActor-M1 (제안) | 24.6 | 0.143 | 72.7% |

지표 해설:

- FID: 낮을수록 현실적

- LPIPS: 낮을수록 GT 이미지와 유사

- Temporal Consistency: 외형의 시간적 안정성 비율

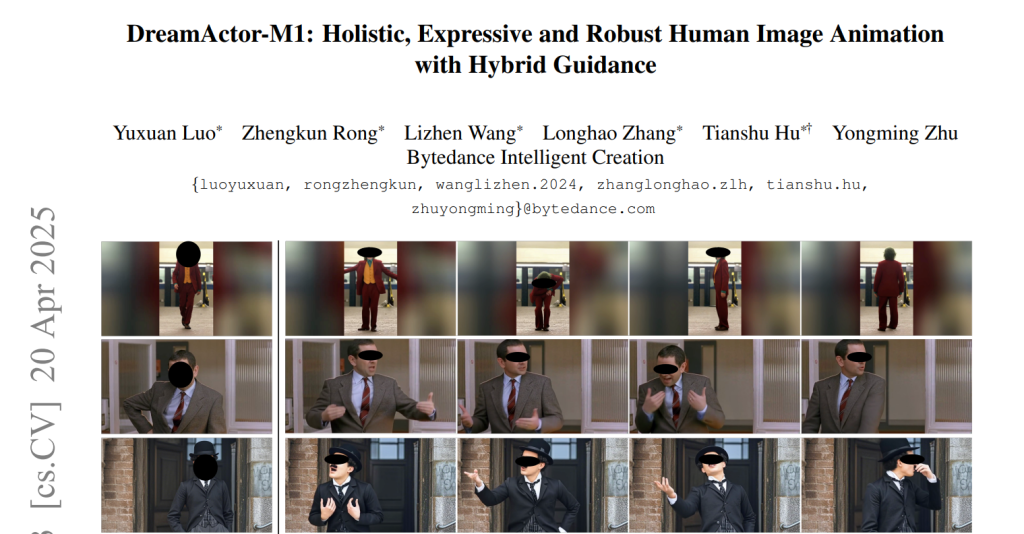

5.2 시각적 품질

- 정적 이미지 한 장으로부터 생성된 장시간 시퀀스에서도 외형이 무너지지 않음

- 얼굴 표정, 머리 회전, 손 제스처 등에서 고해상도 수준의 모션 디테일 구현

6. 리뷰 및 논의

DreamActor-M1은 기존 애니메이션 생성 기술이 겪어온 한계를 기술적으로 정교하게 해결했습니다.

특히 주목할 만한 점은:

- 하이브리드 모션 가이드의 표현력과 해석력

- 점진적 학습 전략을 통한 스케일 적응력

- 멀티 프레임 융합 구조에 기반한 장기 외형 일관성 유지

향후 연구 방향:

- 실시간화: 인퍼런스 속도를 개선하여 영상 통화나 라이브 스트리밍에 응용 가능

- 음성 기반 연동: 오디오 및 감정 분석을 기반으로 표정/몸짓을 자동 연동

- 3D 정합성 강화: 이미지 기반 표현을 넘어, 3D 메쉬 혹은 multi-view consistency 추가 필요

7. 요약 (Conclusion)

DreamActor-M1은 인간 이미지 애니메이션 기술에서 중요한 도약을 이뤄냈습니다.

하이브리드 모션 가이드 + 점진적 학습 + 시간적 외형 일관성을 조합함으로써, 단일 프레임 기반 고품질 애니메이션 생성이라는 목표를 효과적으로 달성했습니다.

이는 디지털 휴먼, 교육 콘텐츠, 가상 아바타 등 다양한 실제 응용에 있어 유망한 접근 방식입니다.

8. 참고 자료 링크

- 📄 논문 원문: https://arxiv.org/pdf/2504.01724

- 🌐 프로젝트 페이지: https://grisoon.github.io/DreamActor-M1

- 💻 GitHub 저장소: https://github.com/Grisoon/DreamActor-M1